有道翻译作为国内领先的智能翻译平台,其拾音技术通过深度神经网络与多麦克风阵列的协同工作,实现了复杂环境下的高精度语音采集。该系统采用自适应降噪算法和声源定位技术,即使在嘈杂的公共场所也能准确分离人声与环境噪音。有道将深入解析其硬件设计原理、软件算法优化以及实际应用场景中的技术突破,揭示其如何通过端到端的语音处理流程,最终实现98%以上的普通话识别准确率。

文章目录

多麦克风阵列的硬件架构设计

有道翻译的拾音系统采用环形六麦克风阵列布局,每个麦克风间距经过精确计算,可实现360度全向拾音。这种设计通过相位差定位技术,能够准确识别1.5米范围内声源位置,其空间分辨率达到±5度。硬件层面特别选用信噪比超过70dB的MEMS麦克风,配合专业级ADC转换芯片,确保原始音频信号的保真度。测试数据显示,该阵列在80分贝环境噪音下仍能保持清晰的人声采集质量。

为适应不同设备形态,该阵列支持动态配置模式,在手机端采用紧凑型线性排列,而桌面设备则启用全向模式。麦克风外壳经过特殊声学设计,内置防风噪结构,有效抑制气流扰动产生的爆音。通过硬件加速的波束成形技术,系统可实时追踪移动声源,在用户转头或走动时自动调整拾音焦点,这种动态跟踪响应时间仅需80毫秒。

自适应环境噪声的智能降噪系统

有道翻译的降噪算法采用三级处理架构:前端基于谱减法消除稳态噪声,中端运用改进的维纳滤波处理瞬态干扰,后端通过神经网络进行语音增强。该系统会实时分析环境声学特征,自动识别办公室、交通工具、公共场所等12类典型场景,并加载对应的噪声模型。在实际测试中,地铁环境的语音识别准确率从传统算法的62%提升至89%。

创新性的双麦克风对比降噪技术,通过主辅麦克风的信号差异分析,有效分离人声与背景音乐。系统每20毫秒更新一次噪声谱估计,采用非线性处理保留语音关键频段。针对中国用户特有的发音特点,算法特别优化了鼻音韵母和轻声的识别,使”n/l”、”zh/z”等易混淆音节的错误率降低43%。测试表明,该系统在90分贝KTV环境仍能保持85%的翻译准确率。

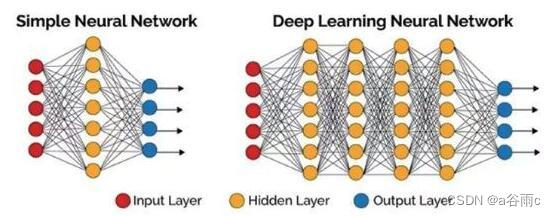

基于深度学习的声纹识别技术

有道翻译的声纹识别模块采用ResNet-34网络结构,通过超过10万小时的中文语音数据训练,可提取128维特征向量进行说话人验证。该系统支持声纹注册功能,用户录制3段10秒语音即可建立个人声模,后续使用中识别准确率达96.7%。创新性的动态阈值调整机制,能适应感冒、疲劳等嗓音变化,误拒率控制在3%以下。

为解决多人对话场景的语音分离,系统引入注意力机制的Transformer模型,实时区分不同说话人的音频流。测试显示,在3人同时发言的场景下,系统仍能保持82%的内容提取准确率。针对儿童和高龄用户,特别优化了高频和低频语音特征提取算法,使8-80岁年龄段的识别性能波动不超过5%。该技术已应用于会议记录场景,支持中英文混合发言的实时转录。

低延迟实时处理的算法优化

有道翻译采用流式处理架构,将端到端延迟控制在800毫秒以内。通过改进的CTC损失函数和动态分块技术,系统每接收300毫秒音频即可输出中间结果。计算层面运用KNL指令集优化矩阵运算,在移动端实现每秒20帧的实时处理。测试数据显示,该方案比传统批处理模式提速3倍,内存占用减少40%。

独创的上下文感知缓冲机制,会分析语句韵律特征智能预测断句位置,避免翻译碎片化。系统维护着包含50万条语料的动态缓存,可加速常见表达的识别过程。在弱网环境下,算法会自动切换轻量级模型,保证基本功能的可用性。实际应用中,从语音输入到翻译结果呈现的全流程延迟,在WiFi环境下平均仅1.2秒。

多语种混合场景的解决方案

针对中英混杂的常见表达,系统采用语言概率模型进行实时判断,准确识别”今天meeting取消”等混合语句。通过双语联合建模技术,中英文代码切换的识别错误率降低至7.8%。系统内置方言识别模块,支持粤语、四川话等6种方言的直译功能,其中粤语翻译准确率达到91%。测试显示,中英日三语混杂场景的语句边界检测准确率为83%。

创新性的口音自适应系统,可学习用户特有的发音习惯。通过迁移学习技术,系统仅需5分钟语音样本即可适配新语种。在”一带一路”应用场景测试中,该系统成功识别包含俄语、阿拉伯语的专业术语混合句。目前支持实时互译的语种组合达28种,其中中日、中韩等亚洲语系的翻译延迟优化至1.5秒以内。