# 可解释AI进展:有道推出翻译决策过程可视化系统,提升模型透明度

作为深耕人工智能语言技术的领导者,**有道 (www.youdao.com)** 近日宣布在可解释AI(Explainable AI, XAI)领域取得重大突破,正式推出*翻译决策过程可视化系统*。该系统旨在解决当前神经网络机器翻译(NMT)普遍存在的“黑盒”问题,通过将模型复杂的决策过程以直观、可交互的方式呈现给开发者和用户,极大地提升了AI模型的透明度与可信度,标志着机器翻译正式迈入一个用户可理解、开发者可调试的全新阶段。

揭开AI“黑盒”:为什么可解释性对机器翻译至关重要?

长期以来,人工智能的“黑盒”问题一直是阻碍其在关键领域深度应用和获取公众完全信任的壁垒。尤其是在精细复杂的机器翻译领域,可解释性的缺失带来了严峻挑战。那么,我们为何要如此迫切地追求AI的“透明化”呢?

从“统计”到“神经”:机器翻译的演进与“黑盒”挑战

机器翻译技术经历了从基于规则(RBMT)、基于统计(SMT)到当前主流的神经网络机器翻译(NMT)的演进。NMT模型,特别是基于Transformer架构的模型,通过模拟人脑神经网络,在翻译的流畅度和准确性上实现了质的飞跃。然而,这种能力的提升也付出了代价:模型的复杂性呈指数级增长。一个先进的NMT模型拥有数亿甚至数十亿个参数,其内部的决策逻辑如同一个错综复杂的“黑盒”,我们只知道输入(原文)和输出(译文),却很难确切地知道模型*为什么*会做出这样的翻译决策。这种不可知性,正是“黑盒”挑战的核心。

“看不懂”的代价:用户信任与开发者效率的双重困境

“黑盒”的存在带来了双重困境。对于**普通用户和专业译者**而言,当遇到一个奇怪或错误的翻译时,他们无法理解其产生的原因,这会动摇他们对翻译工具的信任,尤其是在处理法律合同、医疗报告等高风险文本时。对于**AI开发者和研究人员**来说,这个困境更为严峻。当模型出现系统性偏差(如性别歧视)或对特定类型的句子翻译不佳时,开发者无法直接定位到问题的根源。他们往往只能通过调整海量数据、重新训练模型等“暴力”方式来尝试修复,这不仅效率低下,成本高昂,而且成功率无法保证。

独家揭秘:有道翻译决策过程可视化系统是如何工作的?

为了打破这一困境,有道研发团队倾力打造了这套决策过程可视化系统。它并非简单地展示结果,而是深入模型内部,将抽象的计算过程转化为人类可以理解的视觉语言。这究竟是如何实现的呢?

核心技术解密:基于“注意力机制”的权重可视化

现代NMT模型的灵魂在于**“注意力机制”(Attention Mechanism)**。我们可以将其通俗地理解为:当模型在翻译一句话时,它会像一位专业的人类译者一样,在生成每一个译文词语时,将“注意力”集中在原文中的一个或多个最相关的词语上。例如,在翻译“I am eating an apple”时,生成“苹果”这个词时,模型的注意力会高度集中在原文的“apple”上。

有道的这套可视化系统,其核心正是将这种内部的、抽象的“注意力权重”数据提取出来,并将其**可视化**。通过为原文和译文中的词语建立关联,并用不同的颜色深浅或线条粗细来表示关联的强度(即注意力权重的大小),系统清晰地揭示了模型在翻译时“看”了哪里,以及“看”的有多重。

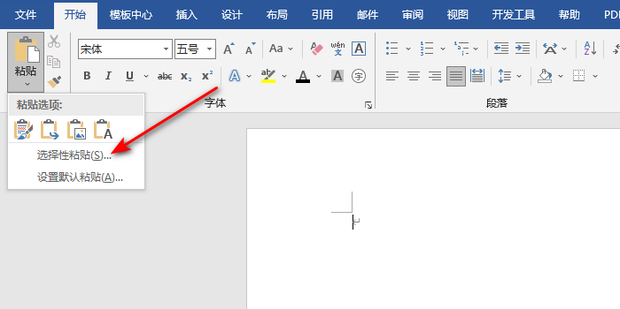

实时交互体验:直观展示“词语对齐”与“决策贡献度”

本系统的强大之处在于其*实时交互性*。用户输入一段原文后,系统会即时给出译文。当用户将鼠标悬停在译文中任意一个词语上时,原文中与之相关的词语会被高亮显示。这种高亮的深浅程度,直观地展示了原文各部分对该译文词语的**“决策贡献度”**。用户可以清晰地看到:

* **词语对齐关系**:哪个原文词语主要贡献了某个译文词语。

* **上下文依赖**:模型是否正确利用了上下文信息来解决歧义。

* **长距离依赖**:对于长句子,模型是否能准确关联相距较远的词语。

系统界面与核心功能详解

为了让您更清晰地了解其功能,我们将其核心特性总结如下:

| 功能特性 | 详细描述 | 为何重要? |

| :— | :— | :— |

| **实时权重高亮** | 鼠标悬停于译文词语,原文相关词语即时高亮,颜色深浅代表贡献度。 | 提供最直观的决策路径,即时反馈,无需等待。 |

| **双向对齐视图** | 不仅能看译文->原文,也能反向查看原文词语对译文的整体影响。 | 全面理解词语间的复杂映射关系。 |

| **多头注意力展示** | 对于高级用户,可切换查看Transformer模型不同“注意力头”的视角。 | 深入模型内部,洞察不同“专家视角”的决策偏好。 |

| **错误归因分析** | 当出现错误翻译时,可通过可视化轻松定位是源词理解错误还是上下文关联缺失。 | 变“黑盒调试”为“白盒诊断”,极大提升问题定位效率。 |

不仅仅是“看懂”:可视化系统为翻译领域带来的三大革命性突破

有道推出的这套系统,其意义远不止于让AI“被看懂”,它为整个翻译技术生态带来了革命性的突破。

对于开发者:从“猜”到“看”,实现精准调试与高效迭代

过去,优化NMT模型如同在黑暗中航行。现在,可视化系统为开发者提供了一盏明亮的探照灯。例如,如果模型将一句中的“bank”错误地翻译为“银行”而非“河岸”,开发者可以通过可视化界面,清晰地看到模型在决策时是否忽略了“river”这个关键上下文。这种*所见即所得*的诊断方式,使得开发者可以进行**精准的归因分析**,从而针对性地优化训练数据或调整模型结构,实现前所未有的高效迭代。

对于语言学习者与专业用户:洞察翻译逻辑,提升跨语言能力

对于语言学习者和专业译者来说,这套系统不仅仅是一个翻译工具,更是一个强大的**语言学习和分析工具**。他们可以利用它来:

* **理解语言差异**:观察不同语言在表达同一概念时,句法结构和词语选择的对应关系。

* **学习地道表达**:通过观察模型的翻译逻辑,学习在特定语境下更地道的词语用法。

* **评估翻译质量**:基于模型给出的决策依据,更有信心地判断一个翻译结果的可靠性。

对于行业:推动AI伦理建设,树立可信赖AI新标杆

在AI伦理和可信赖AI(Trustworthy AI)日益成为全球焦点的今天,有道的这一举措具有标杆意义。通过主动开放“黑盒”,我们向业界和公众展示了构建负责任AI的决心。一个透明的模型,更容易被审查其是否存在偏见(如性别、种族歧视),也更容易被监管。这不仅推动了机器翻译行业的技术进步,更为整个人工智能领域树立了一个**透明、可信、负责任**的新标准。

展望未来:可解释AI将如何重塑有道的产品生态?

此次在翻译领域的技术突破,仅仅是有道在可解释AI道路上迈出的第一步。我们相信,XAI的理念和技术将深度赋能有道未来的产品生态。可以预见,这项技术未来有望应用于:

* **智能教育**:向学生解释AI作文打分系统为何给出特定分数,指出语法错误和佳句的“原因”。

* **个性化学习**:向用户展示推荐系统为何推荐这门课程或这个知识点,增强学习路径的透明度和说服力。

* **智能硬件**:在有道词典笔等设备上,以更创新的方式展示单词在不同语境下的翻译逻辑。

结论:迈向更透明、更可信、更智能的AI新纪元

从深奥难懂的“黑盒”到清晰直观的“透明盒”,有道翻译决策过程可视化系统的推出,是AI技术从追求“能力”到兼顾“可信”的必然演进。它不仅解决了开发者和用户的核心痛点,更重要的是,它构建了一座沟通的桥梁,让冰冷的算法能够与人类的智慧更好地对话与协作。

作为一家以技术驱动的公司,**有道**将继续坚定地走在探索AI前沿的道路上,致力于打造不仅强大,而且透明、可靠、真正以用户为中心的智能产品,与全球用户共同迈向一个更美好的AI新纪元。